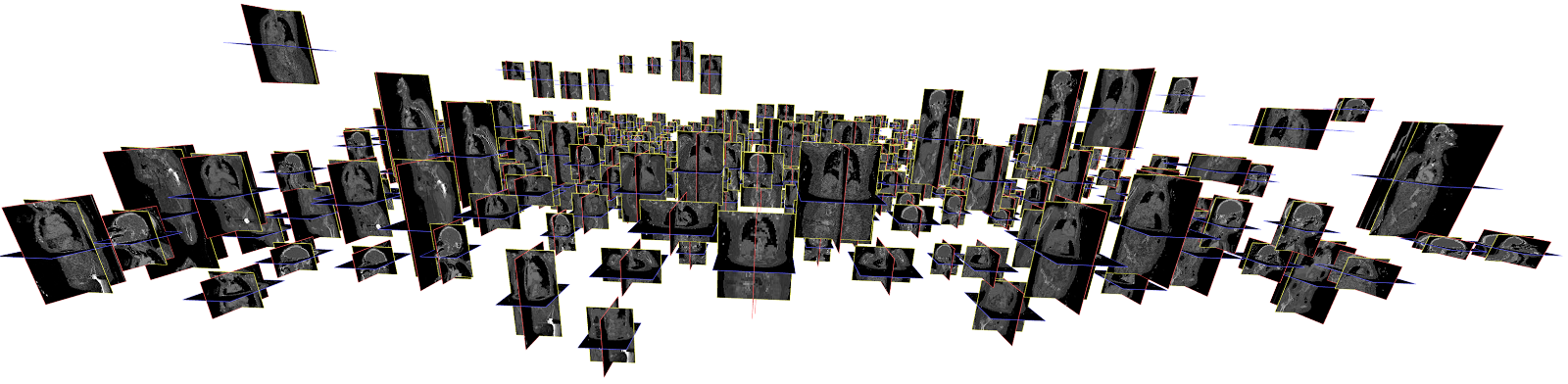

Illustration 1 : 400 images CT. Les positions relatives des images ne sont pas cohérentes, et nécessitent une mise en correspondence. Démo en ligne : https://www.creatis.insa-lyon.fr/~valette/200/.

Introduction

La pratique clinique et la recherche médicale génèrent des milliers d’images médicales, dont l’analyse à pleine échelle est un problème ouvert, car leur nombre et leur taille représentent un volume de données hors normes. Il s’agit du phénomène «Big Data». Le recalage des images, à savoir leur mise en correspondance permettant de détecter et de quantifier la similarité du contenu est une stratégie souvent adoptée en préalable à des applications telles que l’anatomie computationnelle, le suivi longitudinal et la création de modèles numériques personnalisés.

Contexte général et objectifs

L’objectif de ce projet est l’introduction des techniques d’apprentissage automatique permettant d’améliorer la robustesse de notre méthode de recalage actuellement capable de traiter quelques centaines d’images médicales d'une même modalité (CT ou IRM) simultanément [AGIE-16]. Traiter de manière plus robuste une cohorte contenant un plus grand nombre d'images (plusieurs milliers) de modalités potentiellement différentes (CT et IRM) permettra de mettre en évidence des informations anatomiques non décelables par les approches classiques. Une des originalités de notre méthode est l’utilisation des points d’intérêt dans les images, ce qui permet de réduire considérablement le volume de données à traiter et de garantir l’anonymat des patients.

L’apprentissage automatique, un domaine en plein essor aujourd’hui, fournit des méthodes d’extraction de caractéristiques et de définition de métriques permettant de catégoriser les structures apparaissant dans les images. Cependant son application est contrainte par la disponibilité des jeux de données d'apprentissage offrant un grand nombre d'images annotées. Ceux-ci sont rares en imagerie médicale 3D corps-entier du fait du coût d'annotation manuelle élevé et des questions de confidentialité de données. Nous disposons actuellement de plusieurs centaines d’images CT non-annotées et de la base de données Visceral [JIME-16] comportant plusieurs dizaines d'images CT et IRM corps-entier annotées. Nous pourrons prochainement avoir accès à des jeux d'images non-annotées de taille bien plus importante dans le cadre des collaborations en cours avec le CHU de Saint-Etienne et les Hospices Civils de Lyon.

L’originalité de ce projet sera de s’affranchir en partie de la dépendance de données annotées par l’utilisation des images recalées par notre propre approche [AGIE-16]. Le nombre d'images à notre disposition nous permet déjà d’avoir des données d’entrées qui sont suffisamment volumineuses pour les algorithmes d’apprentissage automatique. Les premières applications visées sont :

- La détermination automatique de propriétés telles que le sexe ou l’âge pour une approche novat-rice de l’identification médico-légale évaluative (estimation du profil biologique) des corps altérés,

- La localisation des organes du corps humain, étape préalable pour la segmentation multi-organe d'images [KECH-14] pour la création des modèles numériques personnalisés [KECH-13].

Contexte technique et contributions attendues

Notre algorithme de recalage de groupes d’images [AGIE-16] comporte 3 étapes successives:

- Extraction des points d’intérêt des images. Les points d’intérêt sont les seules données nécessaires pour le recalage, ce qui allège significativement le volume des données à traiter (exemple : pour une image de 500 Mo, environ 50 Mo seulement sont nécessaires pour représenter les points d’intérêt). La détection de points d’intérêts est utilisée avec succès dans le domaine de la vision par ordinateur. Les détecteurs de points d'intérêt les plus connus sont SIFT [LOWE-99] et SURF [BAY-08]. Ils ont été élaborés afin d’optimiser la reproductibilité.

- Mise en correspondance des points d’intérêt. Pour chaque paire d’images, leurs points d’intérêt sont comparés et certains points sont appariés. Pour l’imagerie médicale, une des grandes difficultés est la faible reproductibilité de la mise en correspondance inter-patient : le taux de mauvaises mises en correspondances (« outliers » en anglais) dépasse régulièrement 50%, et peut atteindre 90% dans le cas d’images provenant de scanners ou de modalités différents.

- Recalage du groupe. Un algorithme recale toutes les images dans un même espace en prenant en compte les points d’intérêts mis en correspondance à l’étape 2.

Dans ce projet, nous explorerons deux pistes pour améliorer les étapes 1 et 2 :

- Apprentissage pour la mise en correspondance : Pour surmonter le problème des correspondances aberrantes, nous proposons une approche non-supervisée ou faiblement supervisée pour l’apprentissage sur des grands jeux d’images médicales non annotés. Aucune donnée annotée ne sera nécessaire pour le recalage ; les résultats de notre algorithme existant [AGIE-16] seront utilisées comme données de référence pour l’apprentissage.

- Apprentissage pour l’extraction des descripteurs : Sachant que le domaine d'imagerie médicale 3D a été peu exploré, l’apprentissage supervisé peut automatiquement apprendre des descripteurs ainsi que leur mise en correspondance. Ainsi il serait possible d'atteindre des performances meilleures que celles actuellement rapportées [SIMO-15, BERL-17] en particulier pour le recalage inter-modalité des images CT et IRM. Une possibilité est d'étendre et d'adapter l'approche des réseaux de neurones siamois, utilisée dans [SIMO-15] pour les images naturelles stéréoscopiques, à des spécificités d'images médicales. Les collaborateurs au laboratoire Liris ont effectué de nombreux travaux de recherche sur ces méthodes qui, à partir de données d'images partiellement annotées, apprennent des métriques de similarité (linéaires ou non-linéaires) ayant une grande capacité de généralisation [ZHEN-15, ZHEN-16].

Profil recherché

Nous cherchons un candidat curieux, s'intéressant à l'imagerie biomédicale, sachant travailler en autonomie aussi bien qu'en équipe, ayant un esprit ouvert et critique. Le candidat doit disposer des solides bases en mathématiques appliquées et en informatique, et de bonnes connaissances en traitement d'images. Les connaissances en apprentissage automatique sont un atout.

Candidature

Nous invitons le candidat intéressé à nous envoyer sa lettre de motivation, avec un CV et un relevé de notes récent.

Gratification

Le stagiaire sera rémunéré au tarif prévu par la loi ; ~ 540 € / mois.

Bibliographie

[AGIE-16] R. Agier, S. Valette, L. Fanton, P. Croisille, and R. Prost, "Hubless 3D medical image bundle registration", VISAPP 2016.

[BAY-08] SURF: H. Bay, A. Ess, T. Tuytelaars, L. Van Gool, Speeded Up Robust Features, Computer Vision and Image Understanding (CVIU), Vol. 110, No. 3, pp. 346--359, 2008.

[BERL-17] Berlemont S., Lefebvre G., Duffner S., Garcia C., "Class-balanced siamese neural networks", Neurocomputing, 2017

[JIME-16] Jimenez-del-Toro, O., Muller, H., Krenn, M., Gruenberg, K., Taha, A. A., Winterstein, M., ... & Kontokotsios, G. (2016). Cloud-based Evaluation of Anatomical Structure Segmentation and Landmark Detection Algorithms: VISCERAL Anatomy Benchmarks.

[KECH-13] R. Kéchichian, S. Valette, M. Desvignes et R. Prost, “Shortest-Path Constraints for 3D Multiobject Semiautomatic Segmentation via Clustering and Graph Cut,” IEEE Trans. on Image Processing, vol. 22, no. 11, pp. 4224-4236, 2013.

[KECH-14] R. Kéchichian, S. Valette, M. Sdika et M. Desvignes, “Automatic 3D multiorgan segmentation via clustering and graph cut using spatial relations and hierarchically-registered atlases,” MICCAI Medical Computer Vision: Algorithms for Big Data, 2014, pp. 201-209.

[LOWE-99] David G. Lowe, Object recognition from local scale-invariant features, ICCV 1999, vol. 2, 1999, p. 1150–1157.

[SIMO-15] E. Simo-Serra, E. Trulls, L. Ferraz, I. Kokkinos, P. Fua, and F. Moreno-Noguer, Discriminative Learning of Deep Convolutional Feature Point Descriptors, ICCV 2015

[ZHEN-15] Lilei Zheng, Stefan Duffner, Khalid Idrissi, Christophe Garcia & Atilla Baskurt (2015). "Siamese Multi-layer Perceptrons for Dimensionality Reduction and Face Identification". Multimedia Tools and Applications,,. doi : 10.1007/s11042-015-2847-3. HAL : hal-01182273.